Ученые Самарского национального исследовательского университета разработали инновационную модель, позволяющую точно определить степень участия искусственного интеллекта в создании текстовых материалов. Результаты этого важного исследования были представлены в журнале «Семиотические исследования».

Проблема Авторства в Эпоху ИИ

Стремительное внедрение нейросетей в научную сферу вызывает острые дебаты относительно того, могут ли системы искусственного интеллекта быть признаны полноценными соавторами научных работ. Эксперты из Самарского университета отмечают, что в мировой практике уже зафиксированы случаи, когда ИИ указывается в качестве соавтора или даже единственного автора научных статей. Анализ международных баз данных, таких как Web of Science и Scopus, выявил несколько публикаций, где ChatGPT фигурирует как автор, включая две работы, полностью приписанные ему. При этом в одном случае редакционная коллегия журнала позднее приняла решение об исключении чат-бота из списка авторов.

Изменение Парадигмы Авторства

Исследование Самарского университета подчеркивает, что традиционное понимание авторства требует существенного пересмотра в контексте генеративных моделей ИИ. В новой парадигме человек выступает не просто как создатель, но и как куратор, редактор и интерпретатор сгенерированного контента.

«Мы пришли к выводу, что такие работы обладают гибридной природой. Этот подход открывает путь к новым моделям `распределенного` и `переплетенного` авторства, где ИИ становится участником творческого процесса, но конечная ответственность за содержание остается за `исследователем-человеком`,»

— прокомментировала доцент кафедры социологии и культурологии Самарского университета Наталья Масленкова.

Этические Аспекты и Ответственность

Особое внимание уделяется этическим дилеммам, возникающим при использовании генеративного ИИ в академической среде. Существует риск так называемого «академического мошенничества», когда человек выдает полностью сгенерированный ИИ текст за свой собственный, избегая при этом роли ответственного автора и редактора.

«Наши выводы могут лечь в основу этических и правовых норм, повышающих прозрачность использования ИИ и предотвращающих злоупотребления. Это особенно важно для образовательной, научной и медийной сфер, где возникает вопрос, кто несет ответственность за контент, созданный с участием ИИ,»

— подчеркнула Наталья Масленкова.

Комплексный Подход к Исследованию

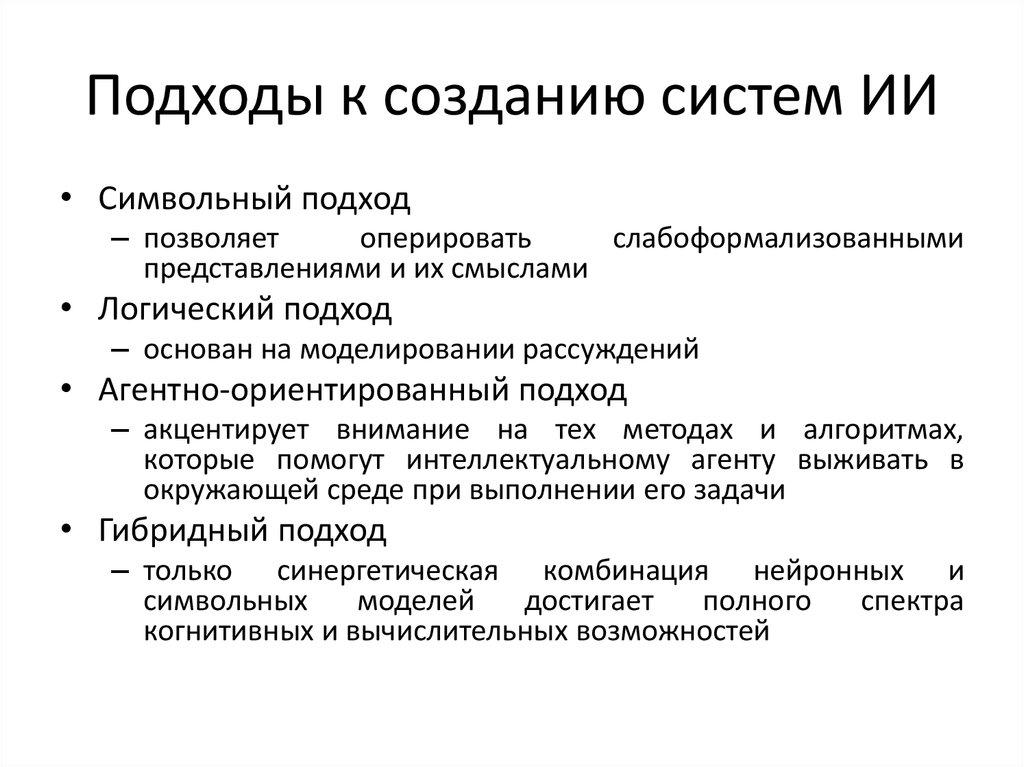

Уникальность данной работы заключается в ее комплексности: она выходит за рамки чисто юридического анализа, интегрируя философский, социокультурный и правовой подходы. Исследователи анализируют современные практики взаимодействия с ИИ через призму теорий распределенного и сетевого авторства, что позволяет глубже осмыслить эволюцию ролей человека и машины в процессе создания текстов.

Одной из рассматриваемых точек зрения является идея о том, что ИИ функционирует как «стохастический попугай», имитирующий человеческую речь на основе статистических закономерностей. В этом контексте, его «субъектность» рассматривается как социальный конструкт, отражающий совокупный вклад как разработчиков, так и конечных пользователей.

Будущие Шаги

На текущем этапе перед учеными стоит задача разработки конкретных рекомендаций по прозрачному и этичному применению генеративных моделей в образовательных и научных публикациях. Также предстоит изучить, как меняются представления об авторстве у различных социальных групп по мере дальнейшего распространения технологий искусственного интеллекта.